Hugging Face 모델 다운로드 완전 가이드 — 가입부터 Llama 3.1 승인까지

Hugging Face 모델 다운로드, 처음 해보면 은근히 헷갈립니다. 가입은 했는데 모델을 받으려니 “Access Denied”가 뜨고, 토큰을 만들었는데 권한이 없다고 하고, 승인 요청을 보냈는데 며칠째 답이 없고… AI 모델 하나 받겠다고 시작했는데 어느새 허깅페이스 고객센터에 문의를 보내고 있는 자신을 발견하게 됩니다.

저도 Llama 3.1 8B 모델을 받으려고 이 과정을 처음부터 끝까지 겪었습니다. 이 글에서는 그 경험을 바탕으로 Hugging Face 가입부터 Gated Model 승인, 실제 다운로드까지 한 번에 정리합니다.

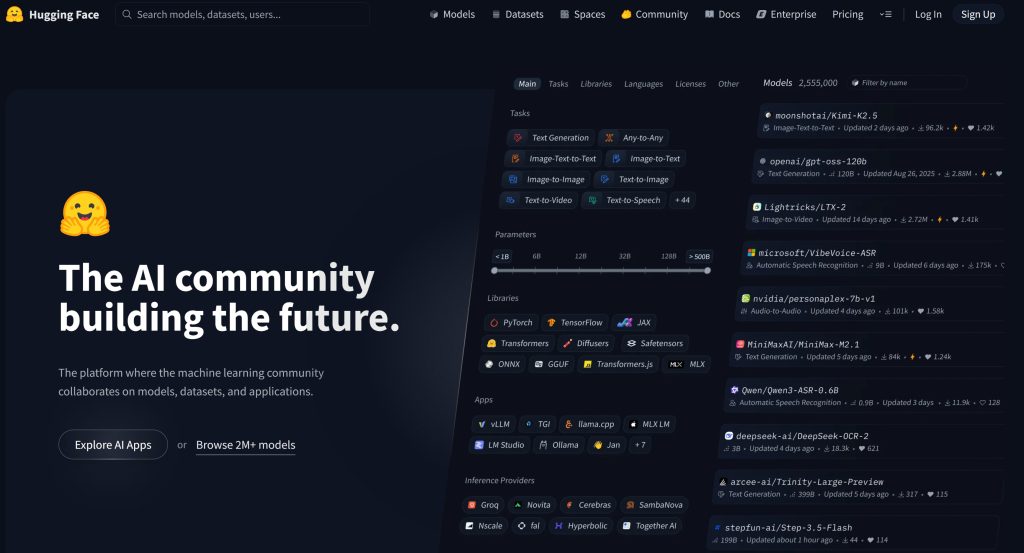

Hugging Face가 뭔데?

Hugging Face(허깅페이스)는 AI 모델의 GitHub 같은 곳입니다. 전 세계 개발자와 기업이 만든 AI 모델, 데이터셋, 데모 앱이 모여있는 플랫폼입니다.

| 항목 | 내용 |

|---|---|

| URL | huggingface.co |

| 등록 모델 수 | 100만 개 이상 |

| 등록 데이터셋 | 25만 개 이상 |

| 비용 | 무료 (Pro 월 $9) |

| 주요 기능 | Model Hub, Datasets, Spaces(데모 앱), Transformers 라이브러리 |

ChatGPT에 쓰이는 GPT는 비공개지만, Meta의 Llama, Google의 Gemma, Mistral AI의 Mistral 같은 오픈소스 모델들은 대부분 Hugging Face에 올라와 있습니다. 여기서 모델을 다운로드해서 내 서버에서 직접 돌릴 수 있는 겁니다.

Step 1. Hugging Face 가입

가입은 간단합니다.

- huggingface.co/join 접속

- 이메일, 비밀번호, 유저네임 입력

- 가입 완료 → 이메일 인증 링크 클릭

GitHub이나 Google 계정으로 소셜 로그인도 가능합니다. 여기까지는 1분이면 됩니다.

💡 유저네임은 나중에 프로필 URL(huggingface.co/유저네임)이 되므로, 깔끔한 이름으로 정하는 게 좋습니다.

Step 2. Access Token 발급 — 모델 받으려면 “신분증”이 필요하다

Hugging Face에서 모델을 다운로드하려면 Access Token이 필요합니다. 웹사이트에서 눈으로 구경하는 건 자유지만, 실제로 모델 파일을 받으려면 “이 사람이 누구인지” 인증이 필요하거든요.

비유하자면, Hugging Face 가입은 놀이공원 입장권이고, Access Token은 특정 놀이기구를 타기 위한 탑승권입니다.

토큰 발급 방법

- 로그인 후 우측 상단 프로필 아이콘 클릭

- Settings → Access Tokens

- Create new token 클릭

- 토큰 이름 입력 (예:

my-download-token) - Token type 선택:

- Read — 모델 다운로드만 할 거면 이거면 충분

- Write — 모델 업로드도 할 거면 선택

- Fine-grained — 세밀한 권한 설정 (고급)

- Create token → 생성된 토큰 복사

🚨 중요: 토큰은 hf_로 시작하는 긴 문자열입니다. 생성 직후 한 번만 보여주므로, 반드시 안전한 곳에 복사해두세요. 잃어버리면 삭제하고 새로 만들어야 합니다.

CLI에서 로그인하기

# huggingface_hub 설치

pip install huggingface_hub

# 터미널에서 로그인 (토큰 입력)

huggingface-cli login토큰을 입력하면 ~/.cache/huggingface/token에 저장되어, 이후 모델 다운로드 시 자동으로 인증됩니다.

Step 3. 모델 찾기 — Model Hub 둘러보기

Hugging Face의 Model Hub에서 원하는 모델을 검색합니다.

검색창에 “llama 3.1″을 입력하면 Meta가 올린 공식 모델들이 나옵니다. 여기서 주목할 건 모델 이름 옆에 붙어있는 태그들입니다:

| 태그 | 의미 |

|---|---|

| 🟢 일반 모델 | 누구나 바로 다운로드 가능 |

| 🔒 Gated | 접근 승인이 필요한 모델. 제작자에게 요청 후 승인받아야 다운로드 가능 |

그리고 바로 여기서 많은 분들이 벽에 부딪힙니다. Llama 3.1은 Gated Model이거든요.

Hugging Face 모델 다운로드 — Gated Model이란?

Gated Model은 말 그대로 “잠금 장치가 걸린 모델”입니다. 모델 제작자(이 경우 Meta)가 누가 자신의 모델을 사용하는지 파악하기 위해, 다운로드 전에 사용자 정보와 이용 약관 동의를 요구합니다.

왜 이런 걸 만들어놨을까요?

오픈소스라고 해서 아무런 조건 없이 쓸 수 있는 건 아닙니다. Meta의 Llama 시리즈는 “오픈 웨이트(Open Weight)” 모델로, 모델 가중치는 공개하지만 라이선스 조건이 있습니다. 예를 들어 월간 활성 사용자가 7억 명 이상인 서비스에서 사용하려면 별도 허가가 필요합니다. 이런 조건을 관리하기 위해 Gated 방식을 사용하는 겁니다.

Step 4. Gated Model 접근 승인 — Llama 3.1 실전 사례

제가 실제로 meta-llama/Llama-3.1-8B-Instruct 모델을 받기 위해 거쳤던 과정을 그대로 공유합니다.

4-1. 모델 페이지 접속

huggingface.co/meta-llama/Llama-3.1-8B-Instruct에 들어가면, 상단에 큰 배너가 보입니다:

🔒 Gated model

You need to agree to the terms to access this model.“Expand to review and access” 버튼을 클릭합니다.

4-2. 양식 작성

Meta의 라이선스 동의 양식이 나옵니다. 작성해야 할 항목:

| 항목 | 작성 예시 | 설명 |

|---|---|---|

| Name | 본인 이름 | 영어 이름 권장 |

| Date of birth | 생년월일 | 정확하게 입력 |

| Affiliation | 회사명 또는 개인 | “Independent developer”도 가능 |

| Country | South Korea | 제재 대상국은 거부될 수 있음 |

| 이용 약관 동의 | 체크 | Meta의 Llama Community License Agreement 동의 |

양식을 작성하고 “Submit”을 누르면 끝입니다.

4-3. 승인 대기

Meta의 Llama 모델은 자동 승인입니다. 제 경우 제출하고 몇 분 내로 승인 이메일이 왔습니다. 다만 상황에 따라 최대 며칠이 걸릴 수도 있다고 합니다.

승인이 완료되면 모델 페이지 상단 배너가 이렇게 바뀝니다:

✅ Gated model

You have been granted access to this model.⚠️ 승인 거절(Rejected) 당했다면? Affiliation을 빈칸으로 두거나, 이메일 인증을 안 했거나, 제재 대상 국가에서 신청한 경우 거절될 수 있습니다. 거절 시 재신청이 어렵기 때문에 처음부터 정확하게 작성하는 게 중요합니다.

Step 5. 실제 Hugging Face 모델 다운로드

승인까지 받았으면, 이제 진짜 모델을 받을 차례입니다. 방법이 여러 가지입니다.

방법 A: huggingface-cli (가장 간편)

# CLI로 다운로드 (먼저 huggingface-cli login 완료해야 함)

huggingface-cli download meta-llama/Llama-3.1-8B-Instruct --local-dir ./llama-3.1-8b이렇게 하면 현재 디렉토리의 llama-3.1-8b 폴더에 모델 파일들이 다운로드됩니다. Llama 3.1 8B 기준 약 16GB정도 됩니다.

방법 B: Python 코드로 다운로드

from huggingface_hub import snapshot_download

# 모델 전체 다운로드

snapshot_download(

repo_id="meta-llama/Llama-3.1-8B-Instruct",

local_dir="./llama-3.1-8b"

)방법 C: transformers로 바로 로드 (다운로드 + 실행)

from transformers import AutoModelForCausalLM, AutoTokenizer

model_id = "meta-llama/Llama-3.1-8B-Instruct"

# 토크나이저 & 모델 로드 (자동 다운로드 + 캐시)

tokenizer = AutoTokenizer.from_pretrained(model_id)

model = AutoModelForCausalLM.from_pretrained(

model_id,

device_map="auto", # GPU 자동 배정

torch_dtype="auto" # 데이터 타입 자동 선택

)

# 테스트

inputs = tokenizer("안녕하세요, 저는", return_tensors="pt").to(model.device)

outputs = model.generate(**inputs, max_new_tokens=50)

print(tokenizer.decode(outputs[0], skip_special_tokens=True))방법 D: Git으로 클론

# Git LFS 필요

git lfs install

# 클론 (토큰 인증 필요)

git clone https://huggingface.co/meta-llama/Llama-3.1-8B-Instruct클론 시 Username에는 Hugging Face 유저네임, Password에는 Access Token을 입력합니다.

방법 E: Ollama로 바로 사용 (가장 쉬운 실행 방법)

사실 Llama 3.1 8B를 “그냥 돌려보고 싶다”면 Ollama가 가장 빠릅니다:

# Ollama로 Llama 3.1 8B 실행 (자동 다운로드)

ollama run llama3.1:8bOllama는 Hugging Face에서 변환된 GGUF 포맷 모델을 자체 서버에서 제공하므로, Hugging Face 승인 없이도 바로 사용할 수 있습니다. 다만 원본 가중치를 직접 활용하거나, 파인튜닝을 하거나, 다른 프레임워크에서 사용하려면 Hugging Face에서 직접 받아야 합니다.

📖 Ollama 설치 및 사용법은 여기서 확인하세요 → Ollama 명령어 완벽 정리 가이드

Hugging Face 모델 다운로드 시 자주 겪는 에러

| 에러 메시지 | 원인 | 해결 |

|---|---|---|

401 Unauthorized |

로그인 안 됨 | huggingface-cli login 실행 |

403 Forbidden“Cannot access gated repo” |

Gated Model 승인 미완료 | 모델 페이지에서 접근 요청 제출 |

403 + “awaiting review” |

승인 대기 중 | 기다리기 (보통 수 분~수 시간) |

403 + 승인 완료인데 안 됨 |

토큰 타입 문제 | Access Token을 Read 타입으로 재발급 |

| “is not the path to a directory” | 인터넷 연결 문제 또는 캐시 이상 | 네트워크 확인, ~/.cache/huggingface 삭제 후 재시도 |

⚠️ 가장 흔한 함정: 토큰을 발급할 때 기본값인 Fine-grained로 만들면 Gated Model에 접근이 안 되는 경우가 있습니다. Gated Model 다운로드 목적이라면 반드시 Read 타입으로 만드세요.

모델 종류별 Hugging Face 모델 다운로드 특징

모든 모델이 Gated인 건 아닙니다. 모델마다 접근 정책이 다릅니다.

| 모델 | 접근 방식 | 승인 소요 |

|---|---|---|

| Mistral 7B | 🟢 자유 다운로드 | 즉시 |

| Google Gemma | 🔒 Gated (자동 승인) | 즉시~수 분 |

| Meta Llama 3.1 | 🔒 Gated (자동 승인) | 수 분~수 시간 |

| Cohere Command R | 🔒 Gated (수동 승인) | 수 시간~수 일 |

“자동 승인”이라고 써있어도 실제로는 몇 시간 걸리는 경우가 있으니, 급한 프로젝트라면 미리 승인 요청을 넣어두는 게 좋습니다.

다운로드 받은 모델, 그 다음은?

Hugging Face에서 모델을 받았으면 다양한 방식으로 활용할 수 있습니다:

transformers로 직접 추론 — Python 코드에서 from_pretrained()으로 로드해서 바로 사용.

파인튜닝 — 내 데이터로 모델을 추가 학습시켜서 특화된 모델을 만들기. LoRA, QLoRA 같은 효율적인 방법을 많이 씁니다.

GGUF 변환 → Ollama/llama.cpp에서 실행 — 가중치를 양자화해서 적은 리소스로 실행.

vLLM/TGI로 API 서버 구축 — 프로덕션 환경에서 모델을 서빙하는 고성능 서버 구축.

📖 로컬 LLM을 텔레그램 봇으로 연결하는 것도 가능합니다 → 텔레그램 봇에 LLM을 연결하는 법

마무리 — Hugging Face 모델 다운로드, 알고 보면 간단하다

정리하면 이 흐름입니다:

1. Hugging Face 가입

2. Access Token 발급 (Read 타입)

3. 원하는 모델 검색

4. Gated 모델이면 → 접근 요청 제출 + 승인 대기

5. CLI / Python / Git으로 다운로드

6. 활용 (추론, 파인튜닝, 서빙 등)처음에는 “AI 모델 하나 받는 데 왜 이렇게 복잡하지?”라고 느낄 수 있지만, 한 번 해보면 그 다음부터는 자연스럽습니다. Hugging Face 모델 다운로드 프로세스를 한 번 익혀두면, 앞으로 나오는 어떤 오픈소스 모델이든 빠르게 받아서 활용할 수 있습니다.

Hugging Face는 단순한 다운로드 사이트가 아니라, AI 생태계의 중심입니다. 모델 뿐 아니라 데이터셋, 논문, 데모 앱, 커뮤니티까지 — AI 개발자라면 매일 들어가게 될 곳입니다. 아직 가입 안 하셨다면, 지금 바로 가입하러 가보세요.

📖 AI 모델을 활용한 다른 프로젝트가 궁금하다면 → Django 실시간 채팅 구현기